Mit mehr als 2 Milliarden Wähler Es wird erwartet, dass die Branchengruppe in diesem Jahr in 50 Ländern an Wahlen teilnimmt Koalition für die Herkunft und Authentizität von Inhalten (C2PA) möchte bei der Bekämpfung von Deepfakes durch den Einsatz von Metadaten und Provenienztechnologie, die die Herkunft eines Bildes verfolgt, führend sein.

Die Idee besteht darin, dass KI-generierte Inhalte ein Etikett wie Nährwertkennzeichnungen für Lebensmittel haben sollten, bei denen es einem Verbraucher nicht verboten ist, Lebensmittel zu kaufen Zuckermüsli, aber kann in den Laden gehen und wissen, was darin ist, und ihre eigene Entscheidung treffen, sagte Andy Parsons, Mitbegründer von C2PA.

Google gab am Donnerstag, 8. Februar, bekannt, dass es der Koalition beitritt, von der die Branche hofft, dass sie anderen die Bedeutung der Kennzeichnung von KI signalisiert -erstellte Inhalte. Das Ziel der Gruppe, die inzwischen 100 Mitglieder und „großes Interesse“ hat, ist, alle Medien mit zubekommen inhaltliche Anmeldeinformationen.

„Wenn Sie sich im Nachrichtenkonsummodus befinden, sollten Sie damit rechnen, dass alle Ihre Bilder, Fotos, Textpakete, Videos usw. dies tun „Inhaltsnachweise haben, die beweisen, dass etwas von dort kommt, wo es sein soll“, sagte er. „Daher kennen Sie das Schlosssymbol. Dass Sie mit HTTPS auf der URL] in Ihrem Browser gesehen wurden. Anfangswar es die Ausnahme. Und heute ist es so häufig und erwartet dass Sie kein Schlosssymbol mehr haben.“ Dadurch könnte das Potenzial von schlechten Akteuren verringert werden.

Wie Technologieunternehmen gefälschte Bilder von schlechten Schauspielern bekämpfen

Es gibt keinen einzigen Weg, Deepfakes zu bekämpfen. Tech-Unternehmen waren eifrig dabei den Regulierungsbehörden voraus Wenn es darum geht, Lösungen zu finden, sei es durch Offenlegungen oder Wasserzeichen, macht das sehr viel Sinn. Da Wahlen so öffentlich sind, Sie wollen sicherstellen, dass sie ein gutes Image in der Öffentlichkeit haben

Im Jahr 2019 entstand die von Adobe mitbegründete Koalition aus der Idee heraus, eine robuste Art von Content-Provenienz zu schaffen das die „Zutaten und das Rezept mit dem Inhalt verbindet. Ungefähr zu dieser Zeit entstand ein Video, das zeigt, wie Nancy Pelosi ihre Worte undeutlich und betrunken klingen lässt , was war entwickelt mithilfe von Algorithmen des maschinellen Lernens, war im Internet im Umlauf, was sie dazu inspirierte, darüber nachzudenken, zu kennzeichnen, ob etwas KI-generiert wurde oder nicht.Im 2021 hatte Adobe zusammen mit Unternehmen wie Microsoft und die BBC haben zu diesem Zweck Open-Source-Implementierungen erstellt

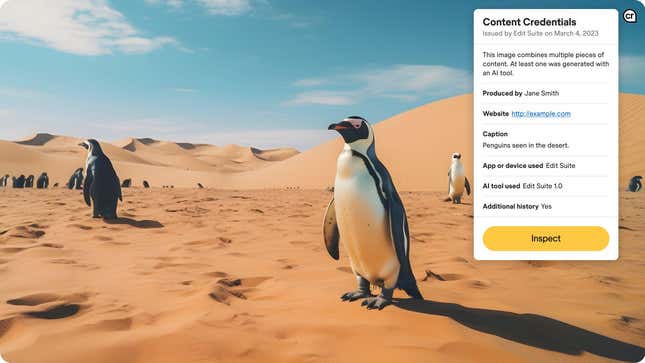

Wie funktioniert es also? Der C2PA-Standard ist ein Open-Source-Manipulationsnachweis, also handelt es sich dabei um Informationen darüber, welches Tool, beispielsweise KI, verwendet wird oder eine Kamera, etwas hergestellt hat, das effektiv an ein Bild angehängt wird absichtlich entfernt, wird es immer noch in der Historie sichtbar sein und kann über die Cloud wiederhergestellt werden. An der visuellen Front sehen die Verbraucher Ein „CR“-Symbol auf dem Bild, auf das sie klicken können, um die „Zutaten“ anzuzeigen.

Aber es gibt keine strenge Regel für Unternehmen, die diese Bezeichnungen übernehmen. Im Jahr 2023 führte Adobe, das die Gruppe ins Leben gerufen hat, sein generatives KI-Modell ein Firefly, das die Content-Anmeldeinformationen von C2PA an jede Bildgenerierung aus seinem generativen KI-Tool Adobe Firefly und an bestimmte KI-gesteuerte Bilder in Photoshop anhängt. Anschließend führte Microsoft die Verwendung von Content-Anmeldeinformationen ein, um alle mithilfe von Bing Image Creator erstellten KI-generierten Bilder zu kennzeichnen. Diese Woche auch OpenAI , einfach angekündigte Bilder Die in ChatGPT generierten Dateien enthalten Metadaten unter Verwendung von C2PA-Spezifikationen.

Google hat noch keine Richtlinien dazu, wie KI-Labels in seinen Bildern verwendet werden. Das Unternehmen weist außerdem darauf hin, dass es mehrere davon gibt Möglichkeiten zur Bekämpfung gefälschter Bilder, einschließlich der Einbettung digitaler Wasserzeichen in KI-generierte Bilder und Audiodaten, Offenlegung politischer Werbung und Kennzeichnung von YouTube-Inhalten Ersteller müssen kennzeichnen, wenn Videos verändert oder synthetisch sind.

Was kommt als nächstes?

Laut C2PA wird es von Kameraherstellern wie Sony und Nikon angenommen, die Kameras herstellen, die das können bieten Authentifizierungstechnologie an. Parsons sagte, er würde gerne sehen, dass sich Hersteller mobiler Geräte der Koalition anschließen und damit beginnen, KI-Etiketten als Teil von Telefonen zu produzieren sind dann für Verbraucher nutzbar .

Angesichts der Tatsache, dass generative KI auch verschiedene Arten von Inhalten wie Video, Bild und Audio produziert, befasst sich die Koalition auch mit der Forschung dazu wie die Erstellung eines KI-Labels für Audio aussieht.

Dieser Inhalt wurde maschinell aus dem Originalmaterial übersetzt. Aufgrund der Nuancen der automatisierten Übersetzung können geringfügige Unterschiede bestehen. Für die Originalversion klicken Sie hier